Hadoop高可用配置

一、何为高可用

1.HA存在的背景

.0之前,在HDFS集群中存在单点故障(SPOF),对于只有一个的集群,若出现故障,则整个集群将无法使用,直到重启。

主要在以下两个方面影响集群

机器出现意外,如宕机,集群将无法使用,直到管理员重启

机器需要升级,包括软件,硬件升级,此时集群也将无法使用

HDFS HA功能通过/两个实现集群中对的热备来解决上述问题。如出现故障,此时很快切换到另外一台机器上。

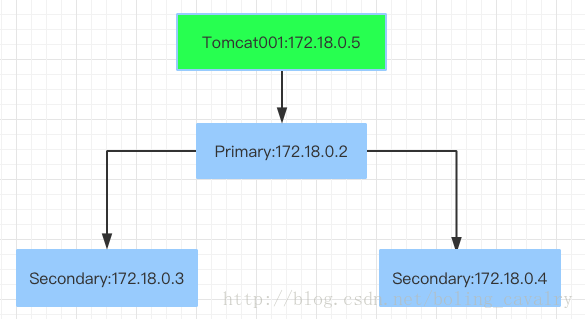

2.工作原理图

3.原理说明

1、 对外提供服务和 时刻待机准备的

2、保证两个任何时候都是元数据同步的

3、 同样需要去读取和edits文件,edits变化后的数据文件同样也是需要实时同步的

4、如何同步日志信息

公司提出一个方案,分布式存储日志文件,编辑日志文件写入,一写写多份,结合之前讲解的ZK的2n+1的概念

策略:写多份,再读取,前提条件节点数目必须是奇数个, 和 有一块共享存储日志的区域

5、日志节点:专门管理编辑日志文件的

注意在HA的架构下,就不需要了

JN日志节点是一个轻量级的,所以可以和的其他守护线程放在一起

6、需要向 实时汇报块的状态信息

7、如何帮助客户端判断HDFS正在提供服务的

通过代理的方式判断

8、在任何时刻下,必须要保证只有一个对外提供服务

当两个启动以后,由ZK来完成选举,选举出一个

隔离机制

二、如何配置

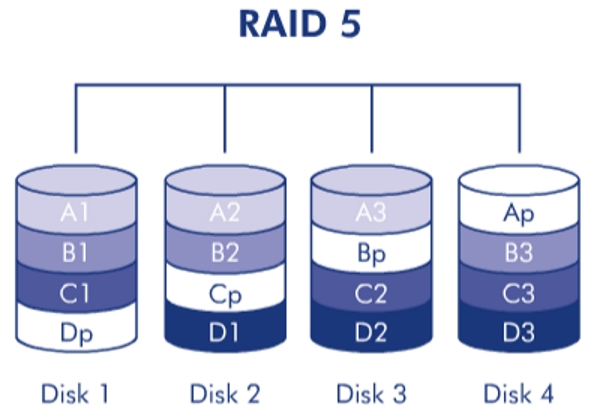

1 集群规划

节点准备:3个节点

:3台

:2台

:多多益善(3台)

:与保持一致

:2台

2.准备工作

1.ip静态化

2.防火墙关闭

3.配置ssh免密登录

4.配置jdk ,环境变量

5.配置

3.配置

1)修改hosts文件

#127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4#::1 localhost localhost.localdomain localhost6 localhost6.localdomain6#前面的给注释掉#添加映射 只有一台 添加一个映射 ,如果多台 全部添加192.168.241.201 test01192.168.241.202 test02192.168.241.203 test032)修改配置文件(把原先的文件存储目录给干掉,之前配置过所以三台节点都需要删除)

(1)修改core-site.xml

fs.defaultFS hdfs://ns

hadoop.tmp.dir /var/hadoop/tmp

ha.zookeeper.quorum test01:2181,test02:2181,test03:2181

ipc.client.connect.max.retries 100

ipc.client.connect.retry.interval 10000 (2)修改hdfs-site.xml

dfs.nameservices ns dfs.ha.namenodes.ns nn1,nn2 dfs.namenode.rpc-address.ns.nn1 test01:9000 dfs.namenode.http-address.ns.nn1 test01:50070 dfs.namenode.rpc-address.ns.nn2 test02:9000 dfs.namenode.http-address.ns.nn2 test02:50070 dfs.namenode.shared.edits.dir qjournal://test01:8485;test02:8485;test03:8485/ns dfs.journalnode.edits.dir /var/hadoop/journal dfs.ha.automatic-failover.enabled true dfs.client.failover.proxy.provider.ns org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider dfs.ha.fencing.methods sshfence dfs.ha.fencing.ssh.private-key-files /root/.ssh/id_rsa dfs.namenode.name.dir file:///var/hadoop/hdfs/name dfs.datanode.data.dir file:///var/hadoop/hdfs/data dfs.replication 3 dfs.webhdfs.enabled true (3)修改-site.xml

mapreduce.framework.name

yarn

mapreduce.jobhistory.address zhiyou101:10020

mapreduce.jobhistory.webapp.address zhiyou101:19888

(4)yarn-site.xml

yarn.resourcemanager.ha.enabled true yarn.resourcemanager.cluster-id yrc yarn.resourcemanager.ha.rm-ids rm1,rm2 yarn.resourcemanager.hostname.rm1 test01 yarn.resourcemanager.hostname.rm2 test02 yarn.resourcemanager.zk-address test01:2181,test02:2181,test03:2181 yarn.nodemanager.aux-services mapreduce_shuffle (5)-env.sh

配置即可

(6)修改文件()

test01

test02

test034.同步

将Java,,,/etc/,/etc/hosts文件同步

同步过的不需要重复同步

5.启动集群

1)分别启动

[root@ bin]# ./.sh start

2)在,02,03分别上启动集群

[root@ sbin]# ./-.sh start

, to /usr/local/-2.7.3/logs/-root--.out

[root@ sbin]# jps

2609

2569

2671 Jps

3)在上格式化zkfc

[root@ sbin]# hdfs zkfc -

4)在上格式化hdfs

[root@ sbin]# -

5)在上启动

[root@ sbin]# ./-.sh start

[root@ sbin]# jps

2609

2871 Jps

2569

2798

6)在上启动数据同步和的

[root@ sbin]# hdfs -

[root@ sbin]# ./-.sh start

7)在 上启动

[root@ sbin]# ./-.sh start

8)在上启动yarn

[root@ sbin]# ./start-yarn.sh

[root@ sbin]# jps

2849

3363 Jps

2708

3076

2760

2970

9)在上单独启动

[root@ sbin]# ./yarn-.sh start

10)在上启动zkfc

[root@ sbin]# ./-.sh start zkfc

说明:第二次启动只需要启动,hdfs和yarn即可,不需要这么麻烦了

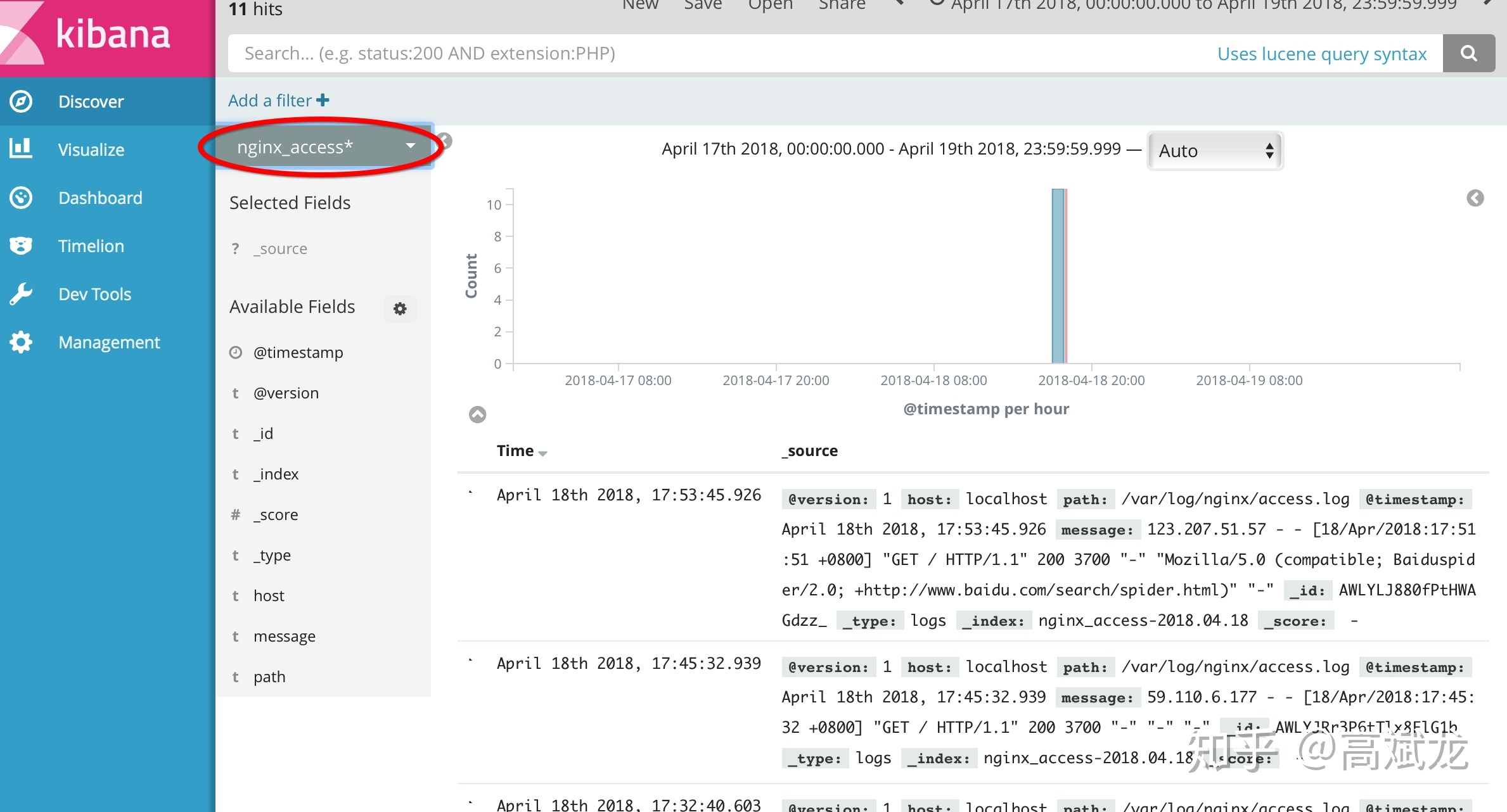

6.查看

三、测试高可用

1.状态

()

()

2.干掉上的

[root@ sbin]# kill -9 [进程id]就是jps前边的数字

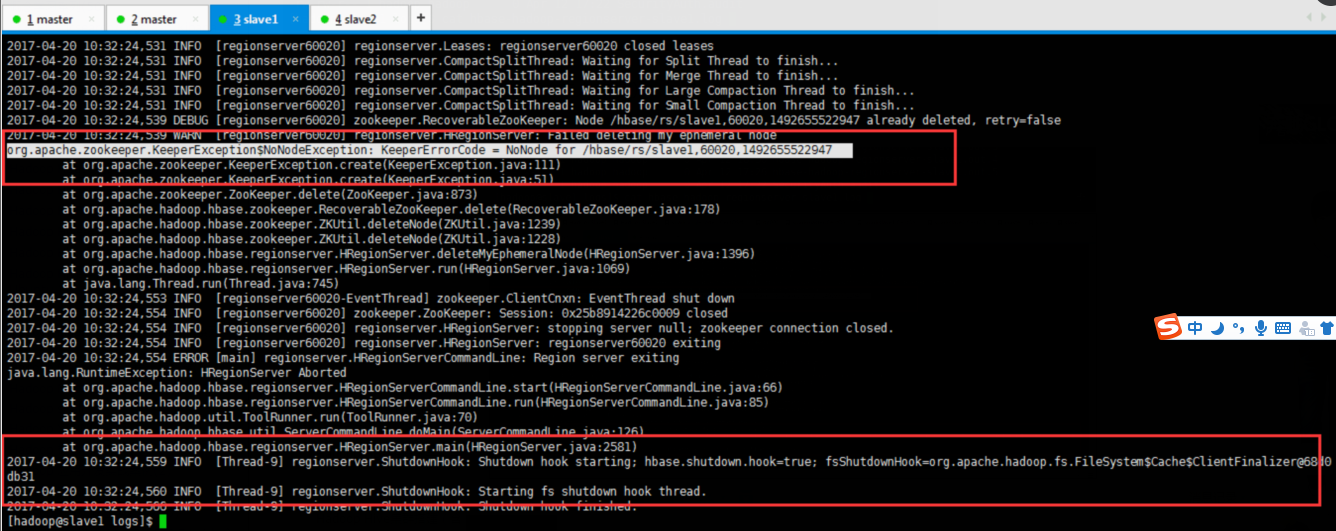

问题:

把干掉后应该自动变成模式,但是没有变化。

系统在任何时候只有一个节点处于状态。

在主备切换的时候, 会变成状态,原来的 就不能再处于状态了,

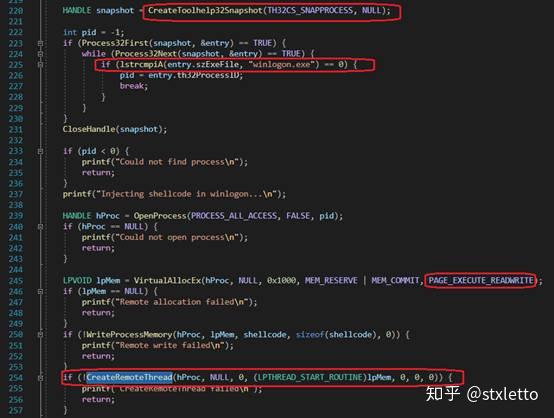

否则两个同时处于状态会有问题。所以在的时候要设置防止2个都处于状态的方法,可以是Java类或者脚本。

的方法目前有两种,和shell

方法是指通过ssh登陆到 节点杀掉进程,所以你需要设置ssh无密码登陆,还要保证有杀掉进程的权限。

解决办法:

在主、备节点上安装fuser(节点不用安装)

[root@ sbin]# yum -y

[root@ sbin]# yum -y

3.重新测试

干掉进程,访问页面

4.创建文件夹