时空图卷积网络STGCN用于交通预测的深度学习框架python程序源代码+设计文

摘要

及时准确的交通预测是城市交通控制和诱导的关键。由于交通流的高度非线性和复杂性,传统的预测方法不能满足中长期预测任务的要求,往往忽略了空间和时间的相关性。本文提出了一种新的深度学习框架时空图卷积网络(STGCN)来解决交通领域的时间序列预测问题。我们不使用正则卷积和递归单元,而是在图上构造问题,并建立具有完全卷积结构的模型,实验表明,该模型通过对多尺度交通网络的建模,有效地捕获了复杂的时空相关性,在各种真实交通数据集上的性能均优于现有的方法。

1.简介

交通在每个人的日常生活中起着至关重要的作用。根据2015年的一项调查,美国司机平均每天开车约48分钟。1在这种情况下,准确实时预测交通状况对道路使用者、私营部门和政府至关重要。广泛应用的交通服务,如流量控制、路线规划和导航,也严重依赖于高质量的交通状况评估。一般来说,多尺度交通预测是城市交通控制与引导的前提和基础,也是智能交通系统(ITS)的主要功能之一。

在交通研究中,交通流的基本变量,即速度、交通量和密度通常被选为监测交通状况和预测未来的指标。根据预测长度,交通量预测一般分为两个尺度:短期(5∼ 30分钟),中长期(30分钟以上)。大多数流行的统计方法(例如,线性回归)都能很好地进行短期预测。然而,由于交通流的不确定性和复杂性,这些方法对于相对长期的预测效果较差。

以往的中长期交通预测研究大致可分为动态建模和数据驱动两大类。动态建模使用数学工具(如微分方程)和物理知识,通过计算模拟来描述交通问题[,2015]。为了达到稳态,仿真过程不仅需要复杂的系统编程,而且需要消耗大量的计算能力。不切实际的假设和简化该模型也降低了预测精度。因此,随着交通数据采集和存储技术的迅速发展,大量的研究人员将注意力转移到数据驱动的方法上。

经典的统计模型和机器学习模型是数据驱动方法的两个主要代表。在时间序列分析中,自回归综合移动平均法(ARIMA)及其变量是最为统一的方法之一

基于经典统计的方法[Ahmed和Cook,1979;威廉姆斯和霍尔,2003年]。然而,这类模型受时间序列平稳性假设的限制,没有考虑到时空相关性,因而限制了高度非线性交通流的可表示性。最近,经典统计在交通预测任务中,机器学习方法对模型提出了严峻的挑战。这些模型,如k近邻算法(KNN)、支持向量机(SVM)和神经网络(NN)可以获得更高的预测精度和更复杂的数据建模。

目前,深度学习方法已广泛成功地应用于各种交通任务中。相关工作取得重大进展,如深度信念网络(DBN)[Jia等人,2016;Huang等人,2014],堆叠式自动编码器(SAE)[Lv等人,2015;陈等人,2016年]。然而,这些稠密网络很难从输入中联合提取时空特征。此外,在狭隘的约束条件下,甚至在完全没有空间属性的情况下,这些网络的代表能力也会受到严重的阻碍。

为了充分利用交通网络的空间特征,一些研究者在时间轴上采用递归神经网络(RNN)的同时,利用卷积神经网络(CNN)来捕捉交通网络之间的相邻关系。通过结合长-短期记忆(LSTM)网络[ and ,1997]和一维CNN,Wu and Tan[2016]提出了一种用于短期流量预测的特征级融合结构CLTFP。尽管CLTFP采取了直接的策略,但它仍然首次尝试调整空间和时间规律。之后,Shi等人[2015]提出了卷积LSTM,它是一种嵌入卷积层的扩展全连接LSTM(FC-LSTM)。然而,通常的卷积运算限制了模型只处理网格结构(如图像、视频),而不是一般的域。同时,用于序列学习的递归网络需要迭代训练,这就引入了误差逐步累积。此外,基于RNN的网络(包括LSTM)被广泛认为难以训练且计算量大。

为了克服这些问题,我们引入了几种策略来有效地建模交通流的时间动态和空间相关性。为了充分利用空间信息,我们用一个通用的图形来模拟交通网络,而不是单独处理它(例如网格或线段)。为了解决递归网络固有的缺陷,我们在时间轴上采用了完全卷积结构。首先,我们提出了一种新的深度学习结构,即时空图卷积网络,该结构由多个时空卷积块组成,它们是图卷积的组合层[ et al.,2016]和卷积序列学习层,用于建模空间和时间依赖性。据我们所知,这是第一次应用纯卷积结构同时从图形结构时间序列中提取时空特征交通研究。我们在两个真实的交通数据集上评估了我们提出的模型。实验结果表明,该框架在多预测长度和网络规模的预测任务中优于现有的方法。

2.初步

2.1道路图交通量预测

交通量预测是一个典型的时间序列预测问题,即根据前面的M个交通量观测值,预测下一个H时间步中最可能的交通量测量值(如速度或交通流),

其中vt∈ Rn是n个路段的观测向量在时间步t,每个元素记录单个路段的历史观测。

在这项工作中,我们定义了一个图上的交通网络和关注结构化交通时间序列。观察点vt不是独立的,而是通过图中的成对连接来连接的,因此,数据点vt可以看作是一个图信号,它定义在一个无向图(或有向图)G上,其权值wij如图1所示。在第t个时间步,在图Gt=(vt,E,W)中,vt是一个有限的顶点集,对应于交通网络中n个监测站的观测值;E是一组边,表示站点之间的连通性;而W∈ 注册护士×n表示加权Gt的邻接矩阵。

图1:图形结构化交通数据。每个vt表示在时间步长t处的当前业务状态的帧,该帧记录在图形结构的数据矩阵中

2.2图上的卷积

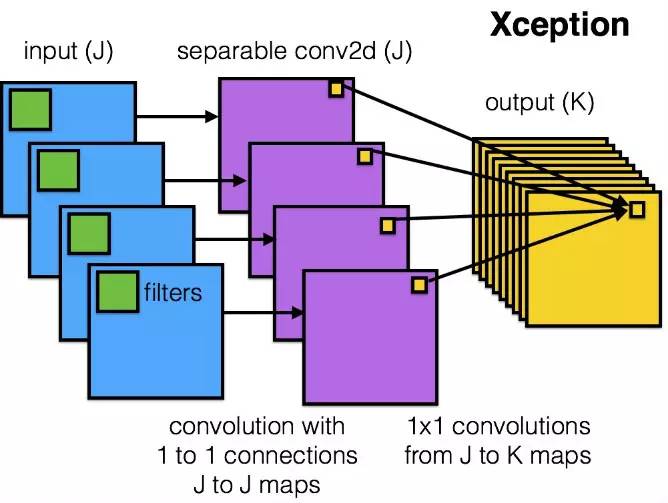

规则网格的标准卷积显然不适用于一般图。目前有两种基本方法正在探索如何将CNNs推广到结构化数据形式。一种是扩展卷积的空间定义[ et al.,2016],另一种是利用图傅立叶变换在谱域进行操作[Bruna et al.,2013]。前一种方法将顶点重新排列成特定的网格形式,这些网格形式可以通过正常的卷积运算进行处理。后者引入了谱域卷积的谱框架,通常称为谱图卷积。一些后续研究通过将计算复杂度从O(n2)降低到线性,使得图卷积更具前景[ et al.,2016;基普夫和韦林,2016年]。

引入图卷积算子的概念∗基于谱图卷积的概念,作为信号x的乘法∈ 带内核的RnΘ,

3.建议模型

3.1网络架构

在这一节中,我们详细介绍了提出的时空图卷积网络(STGCN)的体系结构。如图2所示,STGCN由多个时空卷积块组成,每个空时卷积块形成一个“三明治”结构,中间有两个选通顺序卷积层和一个空间图卷积层,每个模块的细节描述如下。

图2:时空图卷积网络的体系结构。

3.2用于提取空间特征的图形CNN

交通网络一般是以图形的形式组织起来的,用数学的方法来描述道路网络是自然合理的。然而,以往的研究忽略了交通网络的空间属性:网络的连通性和全局性被忽略,因为它们被分割成多个线段或网格。即使在网格上进行二维卷积,由于数据建模的折衷,它也只能粗略地捕捉空间局部性。因此,在我们的模型中,图卷积直接用于图结构数据,以提取空间域中高度有意义的模式和特征。虽然核的计算Θ 由于用图基进行O(n2)乘法,用式(2)进行图卷积的代价很高,为此采用了两种近似策略。

切比雪夫多项式逼近,使滤波器局部化,减少参数个数,核化Θ 可以限制为Λ 作为Θ(Λ) = 主键−1 k=0θkΛk、 在哪里θ ∈ RK是多项式系数的向量。K是图卷积的核大小,它决定了从中心节点卷积的最大半径,传统的方法是用切比雪夫多项式Tk(x)来逼近K阶截断展开的核−1个组件Θ(Λ) ≈ 主键−1 k=0θkTk公司(˜Λ) 重新缩放˜Λ = 2Λ/λ最大值− 在(λmax表示L的最大特征值[ et al.,2011]。图卷积可以重写为,

一阶近似层线性公式可以通过将多个局部化图卷积层与图拉普拉斯的一阶近似叠加来定义[Kipf and ,2016]。因此,可以构造更深层的体系结构来深度恢复空间信息,而不受多项式给出的显式参数化的限制。由于神经网络的标度性和非劣化,我们可以进一步假设λ最大值≈ 2.因此,式(3)可简化为:

θ0, θ1是内核的两个共享参数。为了约束参数和稳定数值性能,θ0和θ1替换为单个参数θ 通过出租θ = θ0 = −θ1; W和D通过˜W=W+In和˜Dii=Σj˜Wij分开。然后,图卷积可以交替地表示为:

在垂直方向上使用一阶近似的图卷积堆栈,获得与K 局部卷积水平方向相似的效果,所有这些卷积都利用了(K−1) 中心节点的有序邻域。在这种情况下,K是模型中连续过滤操作或卷积层的数量。此外,分层线性结构对于大规模图是参数经济且高效的,因为近似的阶数仅限于一。

图卷积的推广图卷积算子∗G“定义在x上∈ Rn可以推广到多维张量。图卷积可以推广为:

3.3用于提取时间特征的门控CNN

尽管基于RNN的模型在时间序列分析中得到广泛应用,但用于流量预测的递归网络仍然存在迭代时间长、门机制复杂、对动态变化响应慢等问题。相反,CNNs具有训练速度快、结构简单、对前一步没有依赖约束等优点。受[ et al.,2017]的启发,我们采用时间轴上的整个卷积结构来捕捉交通流的时间动态行为。这种特殊的设计允许通过多层卷积结构形成分层表示的并行和可控的训练过程。

如图2所示,时间卷积层包含一个一维因果卷积,宽度为Kt核,后跟选通线性单元(GLU)作为非线性。对于图G中的每个节点,时间卷积在没有填充的情况下探索输入元素的Kt个邻域,使得每次的序列长度缩短Kt-1,因此每个节点的时间卷积输入可以看作是一个长度为M的序列,Ci通道为Y∈ 林吉特×Ci公司。卷积核Γ ∈ RKt公司×Ci公司×2Co被设计成将输入Y映射到单个输出元素[pq]∈R(米)−(Kt+1)×(2Co)(P,Q被一分为二,通道大小相同)。因此,时间选通卷积可以定义为,

其中P,Q分别是GLU中的门的输入;表示元素的阿达玛积。σ(Q) 控制当前状态的哪个输入P与发现时间序列中的组成结构和动态方差有关。非线性门也有助于通过堆叠的时间层利用完整的输入场。此外,在堆叠的时间卷积层之间实现残余连接。

下面我们总结一下STGCN模型的主要特点,

•STGCN是处理结构化时间序列的通用框架。它不仅可以解决交通网络的建模和预测问题,而且可以应用于更一般的时空序列学习任务。

•时空块结合了图形卷积和选通时间卷积,可以提取最有用的空间特征,并连贯地捕获最基本的时间特征。

•该模型完全由卷积结构组成,因此可以用较少的参数和更快的训练速度实现对输入的并行化。更重要的是,这种经济架构使模型能够更有效地处理大规模网络。

4.实验

4.1数据集描述

我们在两个真实的交通数据集上验证了我们的模型,北京市交通局收集的BJER4和加州交通委员会,分别。每个数据集都包含流量的关键属性观测和地理信息时间戳,如下所述。BJER4来自东环主要地区北京市四号线采用双环路探测器。在那里为我们的实验选择了12条道路。交通数据是每5分钟汇总一次。使用的时间段是从1开始2014年7月至8月31日,周末除外。我们选择第一个月的历史速度记录作为训练集,和rest分别作为验证集和测试集。

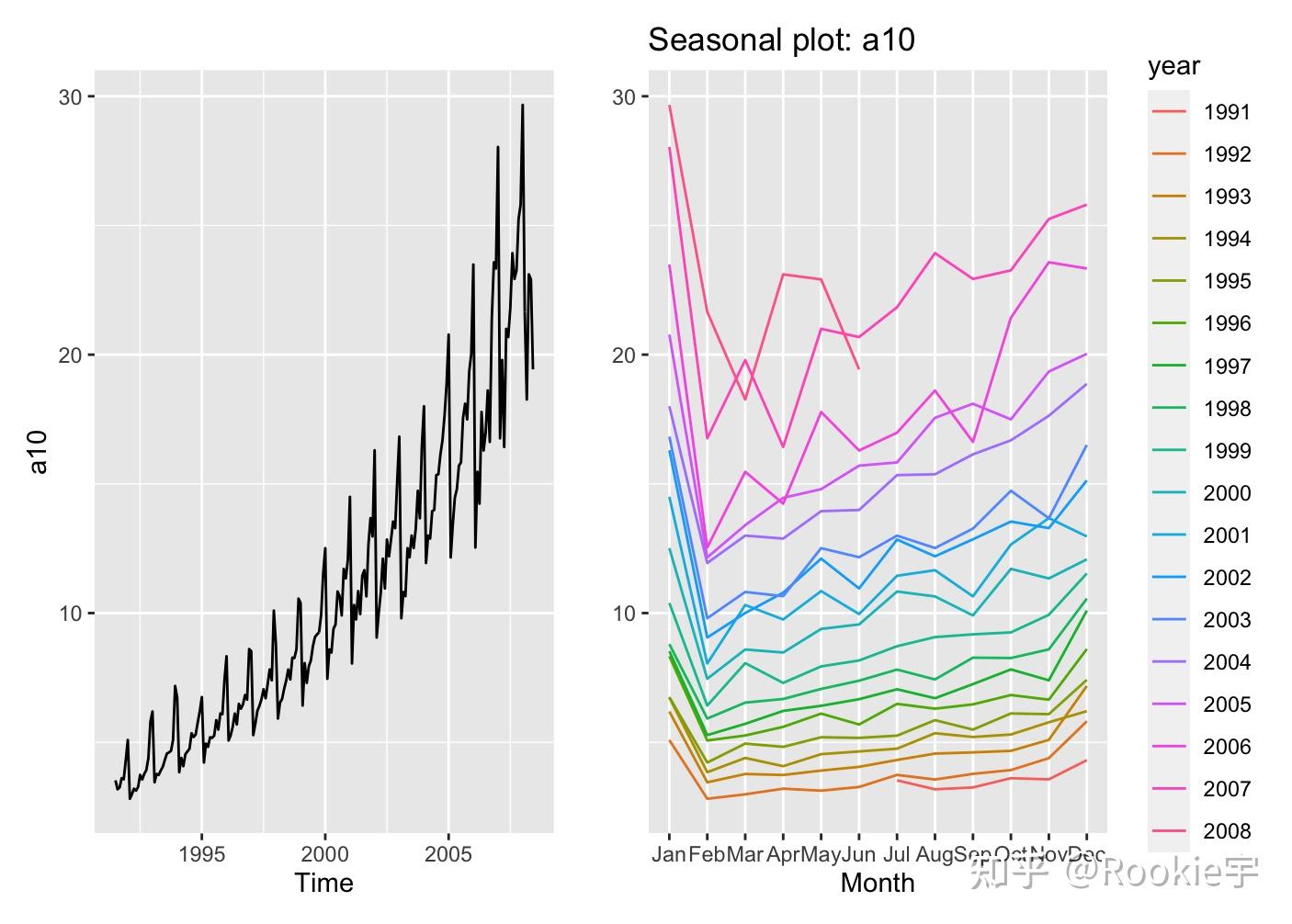

是由部署在加州-伊弗尼亚州高速公路系统主要都市区的39000多个传感器站从加州交通局性能测量系统(PeMS)实时采集的[Chen等人,2001]。数据集也从30秒的数据样本聚合为5分钟的间隔。我们在加利福尼亚州第七区随机选择了一个中尺度和一个大尺度,包含228个和1026个站点,分别标记为(M)和(L),作为数据源(如图3左侧所示)。数据集的时间范围为2012年5月和6月的工作日,我们按照上述相同的原则划分训练集和测试集。

图3加利福尼亚州7区PeMS传感器网络(左),

每个点表示传感器站;加权邻接热图(M)中的矩阵(右)。

4.2数据预处理

两个数据集中的标准时间间隔设置为5分钟。因此,道路图的每个节点每天包含288个数据点。数据清理后,采用线性插值法对缺失值进行填充。在BJER4中,利用传感器站布设直径图构建了北京东四环线系统的道路拓扑结构。通过对每条道路的从属关系、方向和起止点进行排序,环形路线系统可以数字化为有向图。

在中,道路图的邻接矩阵是根据交通网络中站点之间的距离计算出来的。加权邻接矩阵W可表示为:

其中wij是由dij(站i和j之间的距离)决定的边的权重。σ2和是控制矩阵W的分布和稀疏性的阈值,分别指定为10和0.5。W的可视化显示在图3的右侧。

4.3实验设置

所有的实验都是在Linux集群上编译和测试的(CPU:Intel(R)Xeon(R)CPU E5-2620 v4@2.10GHz,GPU: GTX 1080)。为了消除非典型流量,我们的实验只采用了工作日流量数据[Li等人,2015]。我们执行网格搜索策略来定位验证的最佳参数。所有测试都使用60分钟作为历史时间窗口,即12个观测数据点(M=12)用于预测未来15、30和45分钟的交通状况(H=3、6、9)。

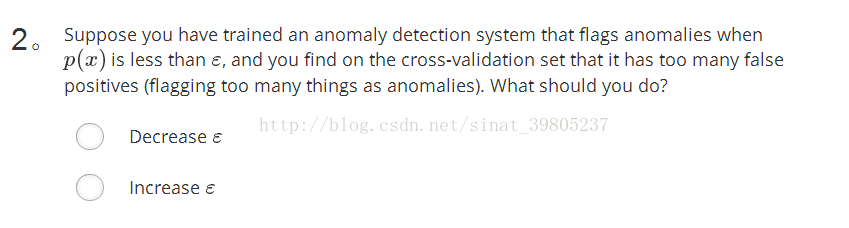

采用平均绝对误差(MAE)、平均绝对百分比误差(MAPE)和均方根误差(RMSE)作为衡量和评价不同方法性能的评价指标和基线。我们将我们的框架STGCN与以下基线进行比较:1)历史平均值(HA);2). 线性支持向量回归;3). 自回归综合移动平均法;4). 前馈神经网络;5) .全连接LSTM(FC-LSTM)[等人,2014];6). 图卷积GRU(GCGRU)[Li等人,2018]。

表1:不同方法的性能比较数据集BJER4

BJER4和(M/L)的STGCN模型,ST Conv区块三层通道分别为64、16、64。在切比雪夫多项式逼近的STGCN(Cheb)模型中,图卷积核大小K和时间卷积核大小Kt都被设置为3,而在一阶近似的STGCN(1st)模型中,K被设置为1。我们训练我们的模型,使用最小化均方误差50个阶段,批量大小为50,初始学习率为10−3,每5个周期衰减率为0.7。

4.4实验结果

表1和表2展示了数据集BJER4和(M/L)的STGCN和基线结果。我们提出的模型在统计显著性方面取得了最好的性能(双尾T检验,α = 0.01,P

空间拓扑的好处

以前的方法没有考虑空间拓扑,而是以粗粒度的方式对时间序列进行建模。不同的是,通过对传感器的空间拓扑进行建模,我们的STGCN模型在短期、中期和长期预测方面取得了显著的改进。STGCN在数据集上的优势比在BJER4数据集上更为明显,因为PeMS的传感器网络更为复杂和结构化(如图3所示),并且我们的模型可以有效地利用空间结构进行更精确的预测。

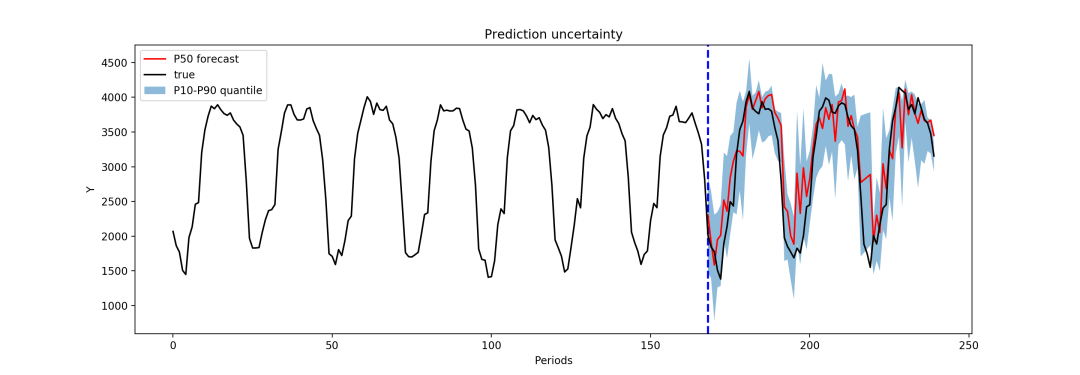

比较基于图卷积的三种方法:GCGRU,STGCN(Cheb)和STGCN(1st),我们展示了他们在早高峰和晚高峰时段的预测,如图4所示。很容易观察到,我们的建议STGCN比其他方法更准确地捕捉高峰时段的趋势;它比其他人更能察觉高峰时间的结束。基于高效的图卷积和叠加时间卷积结构,我们的模型能够快速响应交通网络中的动态变化,而不像大多数循环网络那样过分依赖历史平均值。

表2:数据集上不同方法的性能比较

图4:早高峰和晚高峰的速度预测数据集的小时数

图5:测试RMSE与训练时间(左);测试时间是指训练次数(右)((M))

表3:数据集上的培训时间消耗

训练效率与泛化

为了在我们的建议中看到沿时间轴卷积的好处,我们在表3中总结了STGCN和GCGRU之间训练时间的比较。在公平性方面,GCGRU由三层组成,在(M)的实验中分别有64、64、128个单位,STGCN使用第4.3节中描述的默认设置。我们的STGCN模型只消耗272秒,而RNN类型的GCGRU模型在(M)上花费3824秒。这14倍的训练速度主要得益于时间卷积而不是递归结构,它可以实现完全并行训练,而不是像RNN那样完全依赖于链式结构。对于(L),GCGRU必须使用批处理大小的一半,因为它的GPU消耗超过了单个卡的内存容量(结果在表2中标记为“*”);而STGCN只需要在ST Conv块的中间增加一倍通道。即使在这种情况下,我们的模型消耗的训练时间还不到GCGRU模型的十分之一。同时,由于一阶近似不局限于多项式的参数化,它的优点也逐渐显现出来。与STGCN(Cheb)相比,STGCN(1st)模型在更大的数据集上的速度提高了20%左右,具有令人满意的性能。

为了进一步研究比较的深度学习模型的性能,我们在训练过程中绘制了(M)测试集的RMSE和MAE,见图5。这些数据也表明我们的模型可以实现更快的训练过程和更容易的收敛。由于ST转换模块的特殊设计,该模型在平衡时间消耗和参数设置方面具有优越的性能。具体来说,STGCN中的参数数(4.54× 105)仅占GCGRU的三分之二左右,与FC-LSTM相比节省了95%以上的参数。

5.相关工作

最近有一些深度学习研究也受到时空任务中的图卷积的推动。Seo等人[2016]引入了图卷积递归网络(GCRN)来联合识别数据结构化序列的空间结构和动态变化。本研究的主要挑战是在特定的设定下,确定递归网络与图卷积的最佳组合。基于上述原理,Li等人[2018]成功地使用了具有长期交通量预测的图卷积。与这些工作相反,我们完全从卷积结构建立了我们的模型;ST Conv块专门设计用于统一处理内部有剩余连接和瓶颈策略的结构化数据;我们的模型也采用了更有效的图卷积核。

6.结论及展望

在本文中,我们提出了一个新的深度学习框架STGCN流量预测,结合图卷积和门控时间卷积通过时空卷积块。实验结果表明,在两个真实数据集上,该模型的性能优于其他最先进的方法,表明该模型在从输入数据中探索时空结构方面具有很大的潜力。它还可以实现更快的训练、更容易的收敛、更少的参数以及灵活性和可伸缩性。这些特性对于学术发展和大规模工业部署是非常有前景和实用的。今后将进一步优化网络结构和参数设置。此外,我们提出的框架可以应用于更一般的时空结构化序列预测场景,如社会网络的演化、推荐系统中的偏好预测等。

参考文献

[Ahmed and Cook, 1979] S Ahmed and Allen R Cook. of time- data by using Box- . 1979.

[Bruna et al., 2013] Joan Bruna, , Szlam, and Yann LeCun. and on . arXiv arXiv:1312.6203, 2013.

[Chen et al., 2001] Chao Chen, Karl Petty, , , and Jia. : loop data. : of the Board, (1748):96–102, 2001.

[Chen et al., 2016] Chen, Xuan Song, , and . deep from big and data for . In AAAI, pages 338–344, 2016.

[ et al., 2016] Micha¨el , , and . on with fast . In NIPS, pages 3844–3852, 2016.

[ et al., 2017] Jonas , Auli, David , Denis , and Yann N . to . arXiv arXiv:1705.03122, 2017.

[ et al., 2011] David K , , and Remi . on via graph . and , 30(2):129–150, 2011.

[ and , 1997] Sepp and J¨urgen . Long short-term . , 9(8):1735–1780, 1997.

[Huang et al., 2014] Huang, Song, Hong, and Xie. Deep for : deep with . IEEE on , 15(5):2191–2201, 2014.

[Jia et al., 2016] Yuhan Jia, Wu, and Yiman Du. speed using deep . In ITSC, pages 1217–1222. IEEE, 2016.

[Kipf and , 2016] N Kipf and Max . Semi- with graph . arXiv arXiv:1609.02907, 2016.

[Li et al., 2015] Yexin Li, Yu Zheng, Zhang, and Lei Chen. in a bike- . In , page 33. ACM, 2015.

[Li et al., 2018] Li, Rose Yu, Cyrus , and Yan Liu. : Data- . In ICLR, 2018.

[Lv et al., 2015] Lv, Duan, Kang, Li, and Fei-Yue Wang. with big data: a deep . IEEE on , 16(2):865– 873, 2015.

[ et al., 2016] , Ahmed, and . for . In ICML, pages 2014–2023, 2016.

[Seo et al., 2016] Seo, Micha¨el , , and . with graph . arXiv arXiv:1612.07659, 2016.

[Shi et al., 2015] Shi, Chen, Hao Wang, Dit-Yan Yeung, Wai-Kin Wong, and Wang-chun Woo. lstm : A for . In NIPS, pages 802–810, 2015.

[ et al., 2013] David I , Sunil K , , , and . The of on : high- data to and other . IEEE , 30(3):83–98, 2013.

[ et al., 2014] Ilya , Oriol , and Quoc V Le. to with . In NIPS, pages 3104–3112, 2014.

[, 2015] Eleni I . and for big data: and . In and , pages 107–128. , 2015.

[ and Hoel, 2003] Billy M and A Hoel. and as a arima : basis and . of , 129(6):664–672, 2003.

[Wu and Tan, 2016] Wu and Tan. with - in a deep . arXiv arXiv:1612.01022, 2016.