Rethinking the trigger of backdoor attac

the of

本文是关于后门攻击的论文。本文指出目前的大多数后门攻击的触发集都是属于静态触发集( ),也就是说触发集在训练过程和测试过程的和都是相同的,也就是指,触发模式都是相同的。

这说明一个问题,触发集的鲁棒性会比正常样本差很多。

可以这样理解,训练过程中样本的数量会很大程度上影响训练的效果。后门样本只有一个形式,也就是其训练数据会很少,导致其泛化性能很差,因为没有足够的数据量使其更好地拟合数据。

对输入的触发样本的变换,能够比较轻易地破坏后门攻击。

本文基于这种观点,提出了后门样本的攻击——一种空间转换的方式。想法很简单,做法也很简单。

后门攻击

后门攻击的步骤可以表示为两个步骤:

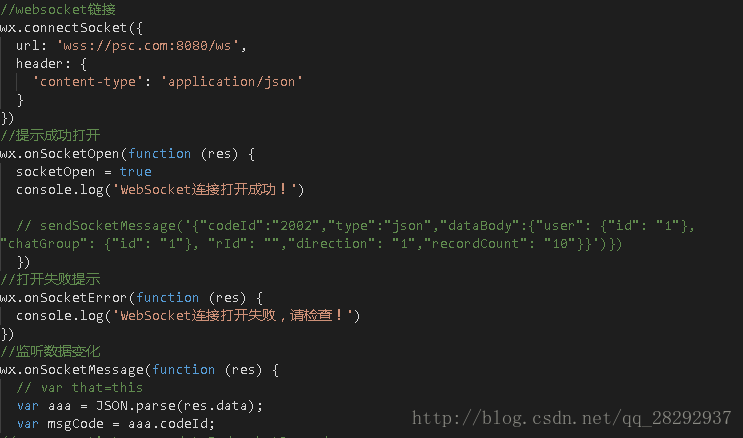

1)生成触发样本及对应的触发标签, ( x p o i s o n e d , y t a r g e t ) (x_{},y_{}) (,)

2)训练。同时使用良性数据和触发集的数据。

x p o i s o n e d x_{} 的生成可以形式化为:

x p o i s o n e d = S ( x ; x t r i g g e r ) = ( 1 − α ) ⊗ x + α ⊗ x t r i g g e r x_{}=S(x;x_{})=(1-\alpha)\ x+\alpha \ x_{} =S(x;)=(1−α)⊗x+α⊗

其中:

α ∈ [ 0 , 1 ] C × W × H \alpha \in [0,1]^{C\times W\times H} α∈[0,1]C×W×H

训练就是正常的训练过程,普普通通的交叉熵函数。

不同特征的影响

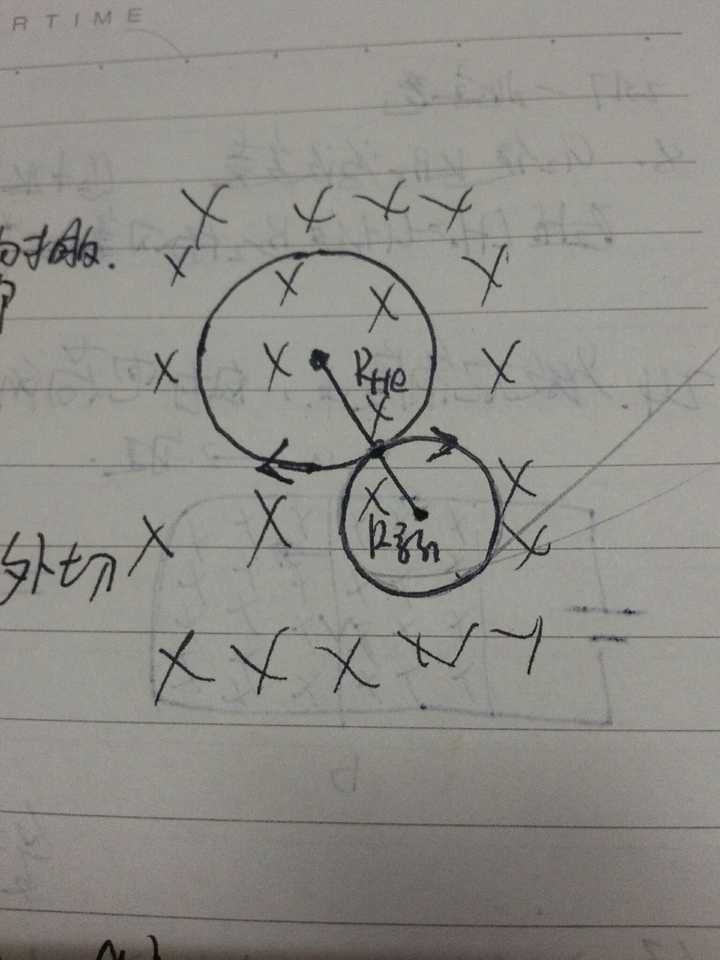

本文将触发模式的特征分为位置和外观。

首先是位置,下图表示触发位于不同位置时候的攻击成功率ASR( rate),可以看出位置的细微变化就能够极大地影响到ASR。

另一种变换就是外观上的差异。初始嵌入的后门模式是128的value,value的取值范围是0~255.这边说明图像的外观变换能够一定程度上影响攻击成功率,但是又不是所有的变化都能够造成影响,这也是一个值得研究的点。

后门防御

Q:能否通过这种敏感性,来防御静态触发集的后门攻击?

A:可以。这种防御需要移动或者变换后门的。但是实际场景中,用户可能并不知道的信息,无法精确操作。因此提出了一种基于转换的防御方式,很暴力啊,就是直接变换整个图像。

比如对整个图像进行翻转或者缩放。

后门防御的攻击

为了增强水印的鲁棒性,很直接的方法就是数据增强。

在训练过程中自己移动的位置,自己对其增加噪声,自己缩放。把对手要走的路走完,那么对手就无路可走了。

那么问题来了,对手走的是什么路?

所以说,提高的鲁棒性的关键就是,如何确定防御者的变换方式和相应的参数。

解决方案是:多做变换。因为并不能确定。当然因为变换存在的可能性是无穷,本文定义了一个变换的集合,以及对应的变换的参数范围,然后使用一种基于抽样的方式来进行变换参数组合。

后门防御的攻击的防御

啊,这个本文没有。

实验结果

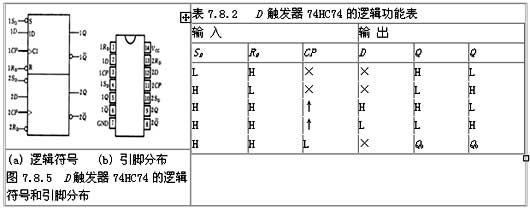

从图5可以看出。在 和 之间的差异。

明显来说, 更加地抵抗扰动。